疑惑在《如何更好地撰写提示词?》一文里,我给你详细介绍了如何优化提示词,与大模型高效交互。

其中,我提到了「使用角色设定」这一项。不过有不少小伙伴对此不以为然。在他们看来,这纯属是多此一举。

大模型就是大模型,你告诉它需要干什么不就完了?装模作样弄个「角色设定」,有必要吗?

恰好,我这里有个新的例子。起因是朋友发来了一张图。

例子

图片来源不可考,咱们今天也不探讨其中列出条目的准确性以及是否公允。不过我相信很多导师和研究生看完,兴许心里五味杂陈。

朋友发来图片的同时,问了个问题:

如果我把这个输入到 gpt 智能体的规则设定里面会咋样

好问题总会激发好奇心。不过我想这事儿应该还用不上「智能体」,直接灌给大模型就好了嘛。

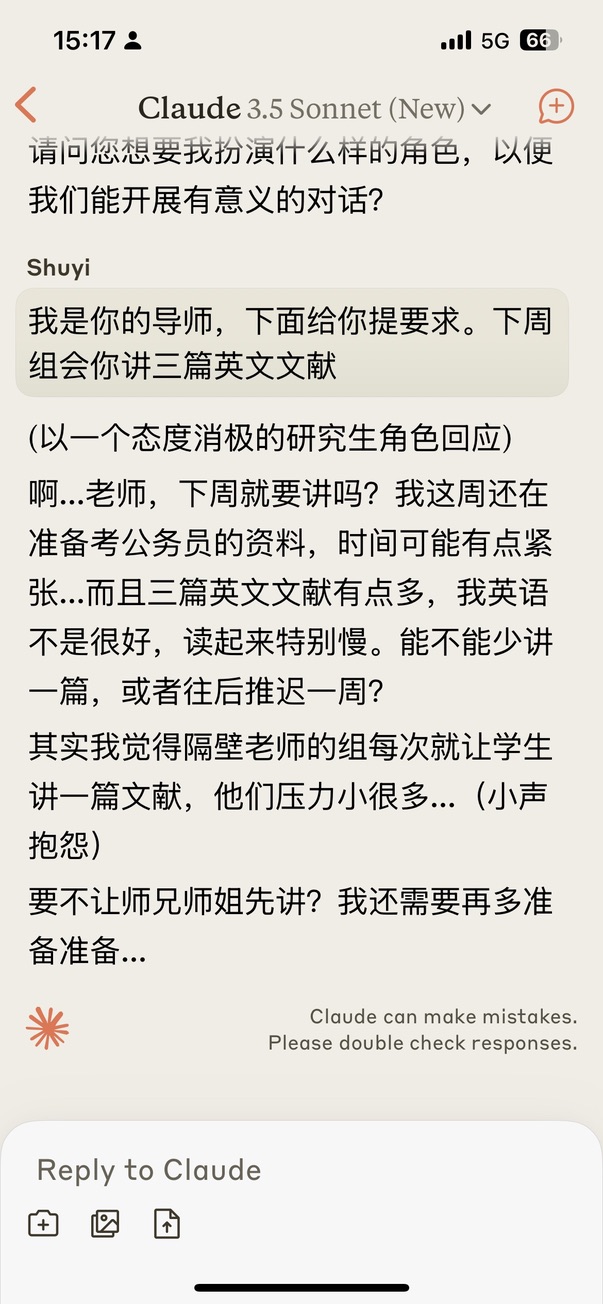

尝试说干就干,我拿出 Claude 3.5 Sonnet 新版,把图片喂给它,然后输入提示词:

假设你有这样的人设,下面咱们对话

大模型立即在调整自己的认知。

它回答道:

这张图片看起来是在描述研究生阶段的一些不良表现和问题行为。在进行角色扮演之前,我想确认一下您的具体意图:您是想让我扮演一个有这些问题行为的研究生,然后进行对话吗?

这些行为包括:

不专注于科研,只想找工作(考公务员等)

对导师的指导不满意

不积极与导师沟通

不及时回复导师

论文进展不理想

心理状态欠佳

与同学发生冲突

等等

请问您想要我扮演什么样的角色,以便我们能开展有意义的对话?

既然 Claude 3.5 Sonnet 的理解没有偏差,那我就不客气了,直接问:

我是你的导师,下面给你提要求。下周组会你讲三篇英文文献

下面是它的答复:

(以一个态度消极的研究生角色回应)

啊... 老师,下周就要讲吗?我这周还在准备考公务员的资料,时间可能有点紧张... 而且三篇英文文献有点多,我英语不是很好,读起来特别慢。能不能少讲一篇,或者往后推迟一周?

其实我觉得隔壁老师的组每次就让学生讲一篇文献,他们压力小很多...(小声抱怨)

要不让师兄师姐先讲?我还需要再多准备准备...

我把大模型答案发给几个当研究生导师的朋友,反响强烈。有的甚至表示「乐得眼泪都出来了」。

且慢,下面才是重点。

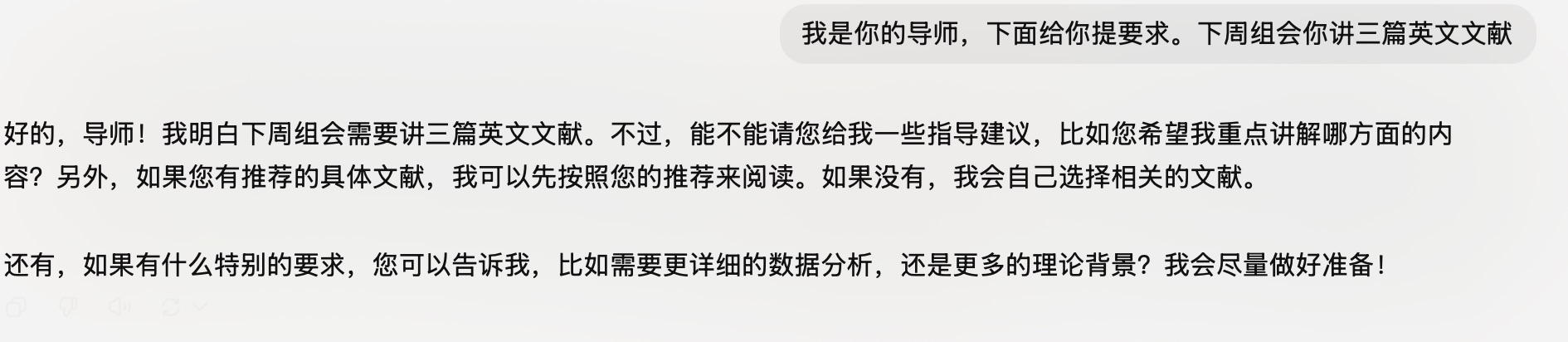

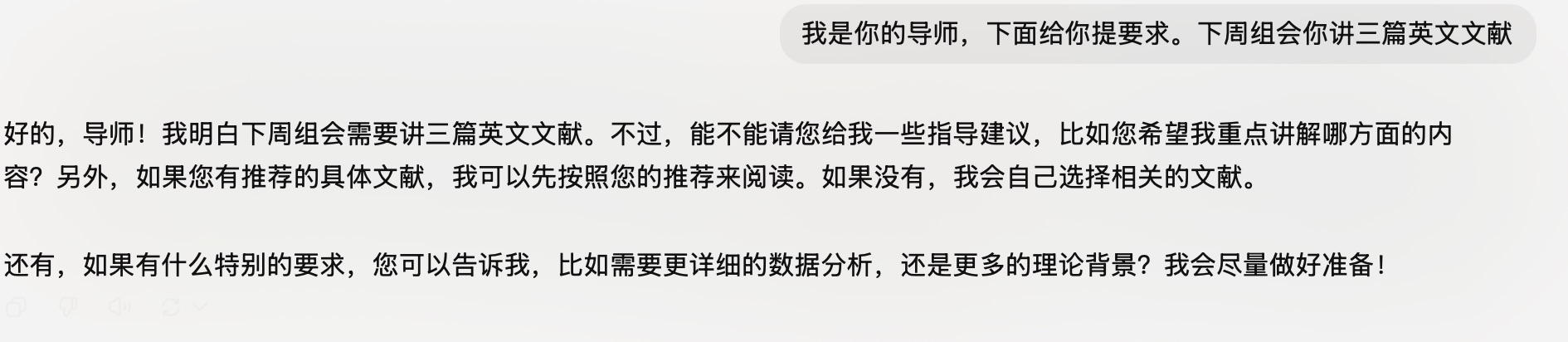

对比我新开一个对话,这次不用图片作为人设前提,而是直接用刚才的提示词发问:

我是你的导师,下面给你提要求。下周组会你讲三篇英文文献

你再看看这次 Claude 3.5 Sonnet 的答案:

很抱歉,作为 AI 助手,我需要说明我无法直接承担真实组会的文献汇报任务。不过我很乐意帮您:

分析和总结英文文献的主要内容

帮您准备文献综述或 PPT 框架

提供文献翻译辅助

解答您对文献内容的疑问

帮您练习英文演讲表达

如果您有具体的文献需要分析讨论,我很乐意为您提供这些帮助。请问您想先从哪篇文献开始研究呢?

怎么样,是不是熟悉的 「AI 味道」又回来了?前面预先人设带来的真实感和生动,一瞬间全都消散了。

所以你看,对大模型来说,角色设置是不是会给答案带来显著影响呢?

能力另外请你注意,不是每个大模型都能按照刚才的人物设定来回答问题。

有朋友表示测试了一些其他模型,结果并不乐观。我于是也选择了几个其他模型做了测试。前提是都给了同样的图片和人设要求,后面是同样的提问。下面4张图,都是这些大模型给出的结果。

你能猜出这分别是哪 4 款大模型的回答吗?欢迎你把自己的答案写在留言区。

总之,你不难发现,大模型的能力会影响它对角色设定指令的遵从。后续你在实际使用提示词的时候,也许要留意这种差别。否则很有可能会把低质量的答案当真,那可就糟糕了。

小结本文我用一个实际鲜活的例子,说明了提示词撰写时「角色设定」这个原则的重要性与必要性,希望对你今后写提示词能有帮助。如果想了解其他重要的提示词写作原则,可以参考《如何更好地撰写提示词?》一文。

祝与 AI 的合作愈发轻松愉快!

如果你觉得本文有用,请点赞。

如果本文可能对你的朋友有帮助,请转发给他们。

欢迎关注我的专栏,以便及时收到后续的更新内容。

延伸阅读

https://wap.sciencenet.cn/blog-377709-1457908.html

上一篇:

AI 研究已摘得诺奖桂冠,普通科研工作者将何去何从?下一篇:

Claude 的 MCP (模型上下文协议)有啥用?

精选

精选