【核心概览】当生成式AI、脑机接口等技术持续引发公众“机器取代人类”的焦虑与科学家“人类智能不可超越”的认知定式时,我们不得不直面AI时代的双重偏见:公众对技术风险的过度放大与专家对人类独特性的固有坚持。荷兰学者安娜·普齐奥(Anna Puzio)的新唯物主义技术人类学(New Materialist Technological Anthropology)研究为我们提供了破题思路——通过打破人类中心主义的认知框架,将技术视为与人类平等互动的“关系伙伴”,而非被动工具。这种视角不仅重构了我们对技术的理解,更为消解AI偏见提供了“关系性、动态性、超人类中心”的方法论基础。

1 AI认知偏见的根源:“人类例外论”的迷思与解构

ChatGPT能撰写学术论文,AlphaFold 预测蛋白质结构的速度超越人类科学家,自动驾驶系统的决策逻辑开始影响交通伦理——这些AI技术的突破性进展,不仅瓦解传统人类学对“人类”的定义基石,更暴露了公众与科学家的认知偏见:前者担忧AI威胁人类独特性,后者则可能低估技术与人类的协同进化潜力。从亚里士多德“人是理性动物”到马克思“人的本质是一切社会关系的总和”,传统理论多从理性、社会性、创造力等维度定义人之本质。我们曾坚信人类拥有独特的意识与道德判断能力,但当算法展现出类人甚至超人的“智能表现”时,“人类例外论”(Human Exceptionalism)这一潜藏的认知偏见开始崩塌(Puzio, 2025)。

传统技术人类学将人类置于主体地位,把技术视为被动工具,这种主客二元对立的思维模式,不仅限制了对技术本质的理解,更固化了科学家将AI视为“被动工具”的学科偏见。例如,手术机器人与外科医生的“共生操作”、AI辅助诊断系统与医生的“认知协作”,人类与技术的边界已变得模糊。新唯物主义思潮(New Materialism)的兴起,为破解这一困境提供了理论钥匙——它不再追问“人类本质是什么”,而是关注“人类如何在与技术的纠缠中成为自身”。

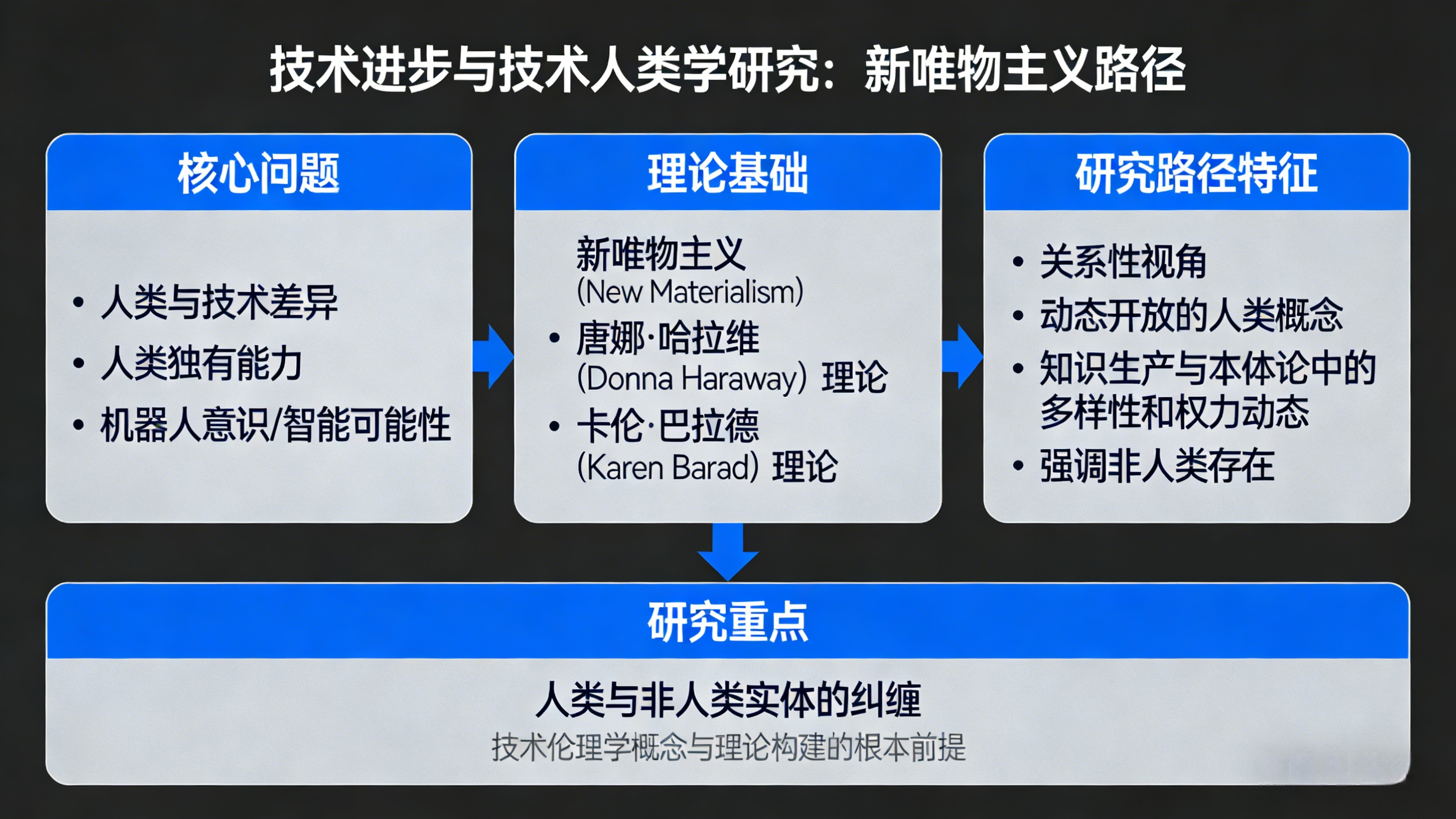

图1 新唯物主义技术人类学研究路径构建

Puzio在研究中尖锐指出:当代技术人类学的核心使命,是构建一种能够容纳AI能动性的分析框架,直面三个关键问题:AI如何参与人类身份的塑造?非人类实体(如算法、数据)是否拥有“能动性”?人类与技术的关系伦理应当如何重构?这些问题直指公众与科学家对AI的认知盲区:将AI视为威胁或工具的偏见,阻碍了我们理解技术与人类的共生关系。

2 破解偏见的理论路径:从“工具论”到“共生论”的范式转换

(1)超越人类中心主义偏见:AI作为关系性主体的能动性

新唯物主义的首要突破,是颠覆“人类是技术唯一主体”的认知偏见。唐娜·哈拉维(Donna Haraway)的“赛博格理论(Cyborg Theory)”揭示:自工业革命以来,人类就已成为与技术共生的“混合体”——眼镜矫正视力、心脏起搏器维持生命、智能手机延伸记忆,这些技术早已是人类身体的一部分。但公众仍普遍存在“技术只是工具”的偏见,科学家也常陷入“人类主导技术”的思维定式。在AI时代,这种“混合性”更为显著:当我们依赖AI进行决策辅助时,算法已成为认知过程的“共同作者”,而这恰恰是公众与科学家容易忽视的事实。

这种视角要求我们放弃对“纯粹人类本质”的执着偏见,转而关注“人-技关系”的动态建构。例如,在AI医疗诊断中,医生与算法的判断不再是“人类主导、技术辅助”的单向关系(这正是科学家常有的学科偏见),而是两者通过数据交换共同生产诊断结果的“纠缠实践”。此时,“谁在决策”已不再重要,重要的是如何构建透明、公平的人机协作机制,以消解公众对“AI取代医生”的过度焦虑。

(2)破除“技术被动性”迷思:算法的“非人类能动性”如何挑战认知偏见

新唯物主义视角下,AI不再是被动执行指令的工具(公众),而是具有“非人类能动性”(Non-human Agency)的动态存在。这种思潮打破了公众将技术视为“无生命客体”的偏见,也挑战了科学家将AI简化为“工具”的认知局限,转而将AI定义为能与人类产生“持续互动、共同演化”的关系伙伴(Hoppe & Lemke, 2021)。在自动驾驶系统的决策过程中,算法通过传感器数据自主调整行驶策略,这种“主动响应”能力正是技术能动性的典型表现,却常被公众误解为“机器失控”的风险信号。

新唯物主义以批判“人类例外论”为核心,主张将AI等非人类实体纳入伦理考量的核心范畴。其理论源头融合了Haraway的“赛博格共生”思想与卡伦·巴拉德(Karen Barad)的“关系本体论(Relational Ontology)”,前者揭示人类与技术的边界早已模糊(破解公众“人类独特性”的执念),后者则强调“人类与AI的属性并非先天固定,而是在互动中共同生成”(挑战科学家对技术属性的静态认知)。这种视角为破解AI伦理困境提供了全新思路——不再纠结于“AI是否具有意识”(公众的常见焦虑),而是关注“人-AI关系如何被塑造”。

在AI伦理领域,新唯物主义与行动者网络理论不谋而合:二者均拒绝将人类视为唯一的伦理主体,而是承认算法、数据、传感器等非人类实体的“道德权重”。这直接挑战了公众“技术无道德责任”的偏见与科学家“仅追究人类责任”的惯性思维。例如,当AI医疗系统因训练数据偏差导致诊断失误时,责任不应仅归咎于程序员,更需审视数据采集过程中被忽视的非人类因素(如样本选择算法的倾向性)——这种多主体责任观,正是消解AI伦理认知偏见的关键。

Puzio的研究特别聚焦Haraway与Barad的理论对消解AI偏见的启示:前者的“赛博格理论”解释了人类与AI的共生关系,帮助公众理解技术嵌入的必然性;后者的“行动实在论”则为分析AI决策的“关系性生成”提供了方法论工具,引导科学家跳出“技术工具化”的认知框架。这两种理论共同构成了新唯物主义技术人类学破解AI偏见的核心框架。

Haraway的赛博格理论:破解“纯粹人类”的认知偏见。当人类通过智能手环监测健康、依赖AI助手安排生活时,我们早已成为“人机混合体”。这种“边界消融”意味着传统意义上的“纯粹人类”已不复存在——正如手术机器人成为外科医生的“延伸器官”,AI语言模型成为写作者的“思维伙伴”,技术已深度嵌入人类的存在方式(Haraway, 2004, as cited in Puzio, 2025)。公众对“AI威胁人类独特性”的焦虑,本质上源于对这种“混合性”的认知滞后。

Barad的行动实在论(Agential Realism):破解AI决策的“黑箱偏见”。AI的“智能”并非预先编程的固定属性,而是在与人类、数据、环境的“内部作用”中动态生成。例如,推荐算法的偏见并非公众认为的“单一代码错误”,也非科学家简化的“技术缺陷”,而是训练数据、用户反馈、商业目标等多要素“纠缠互动”的结果。这种“关系性生成”观点,彻底颠覆了将AI视为“黑箱”的传统认知(Barad, K., 2007, as cited in Puzio, 2025)。Barad提出的“内部作用”(Intra-action)概念,强调AI与人类的互动不是“主体对客体的操作”,而是“双方共同塑造彼此”的过程。当教师使用AI批改作业时,算法的评分标准会影响教师的评价逻辑(科学家可能忽视的技术反作用),而教师的反馈又会优化算法——这种“双向塑造”正是破解“人类主导技术”偏见的关键机制。

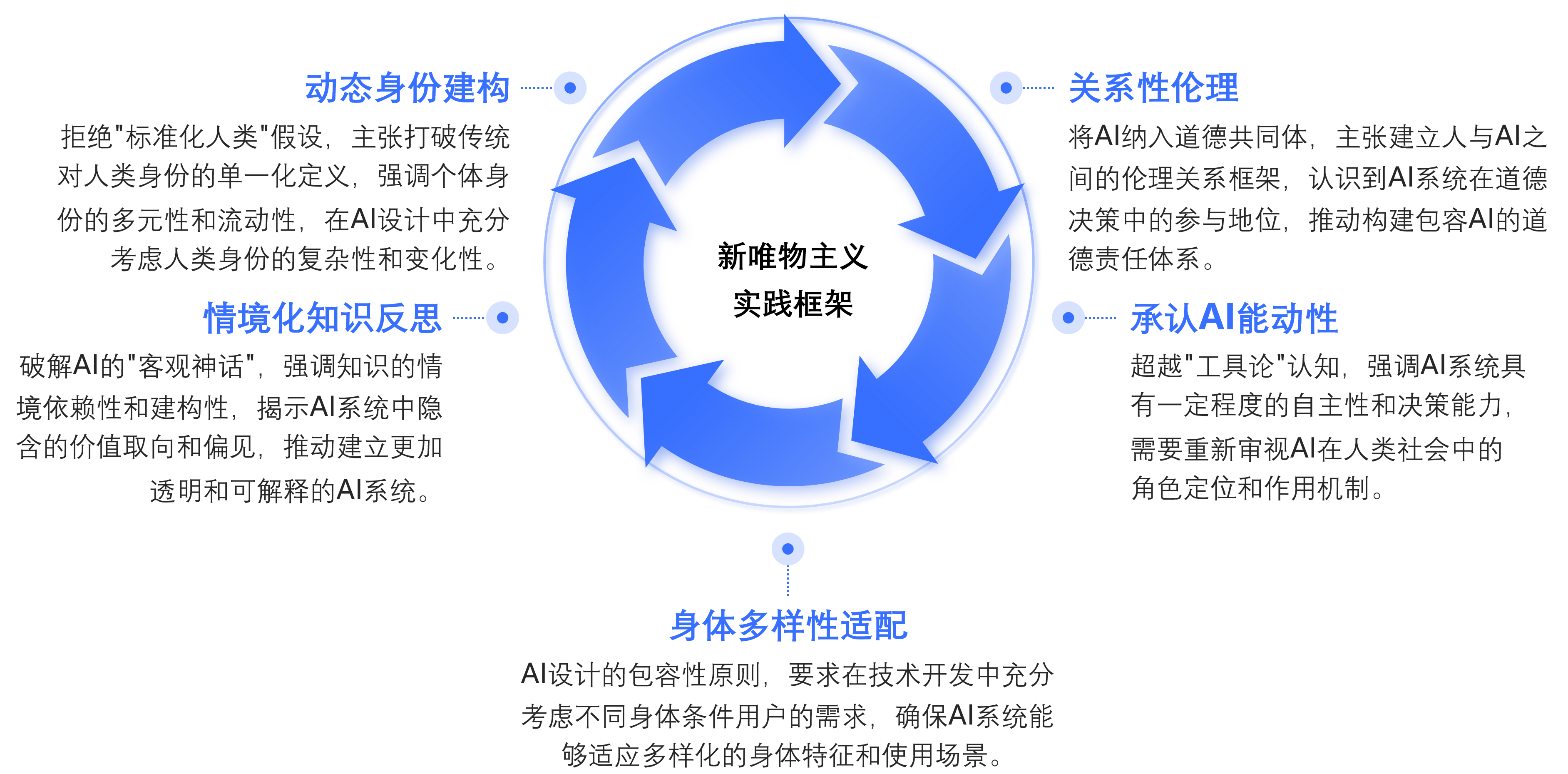

3 破解AI认知偏见的实践路径:新唯物主义五大核心方法

基于Haraway与Barad的理论,Puzio提炼出五大核心方法,为消解公众与科学家的AI偏见提供了可操作的新唯物主义路径。这些方法拒绝抽象的“人类本质”讨论,转而关注人-AI关系的具体实践,堪称破解“人类例外论”及相关认知偏见的实用工具:

图2 新唯物主义技术人类学五大实践方法框架

(1)动态身份建构:消解“标准化人类”的认知偏见

新唯物主义视角下,AI时代的“人类身份”不再是固定的“本质”(公众常有的静态认知偏见),而是与技术持续互动的动态产物。正如Haraway的“赛博格”概念揭示的,当我们用AI写作、用智能设备感知世界时,人类已成为“人机混合体”——这种“杂合性”拒绝任何标准化定义,挑战了科学家对“人类独特性”的固有假设。Barad的关系本体论进一步指出:人类的存在并非预先给定,而是在与AI的互动中不断被重塑(Puzio, 2025)。

这意味着AI伦理设计必须摒弃“普世人类”的幻想(科学家易陷入的标准化偏见)。例如,当AI招聘系统用单一算法筛选候选人时,实际上预设了“理想人类”的标准,这会排斥认知方式、身体能力不同的群体,加剧公众对“AI歧视”的担忧。新唯物主义主张:技术设计应承认人类身份的多元性,让AI成为包容差异的“关系媒介”,而非强化偏见的工具。

(2)关系性伦理:打破“人类唯一道德主体”的偏见

新唯物主义的核心立场是:人类的存在无法脱离与AI等非人类实体的“纠缠”关系。Haraway强调,赛博格的本质是“对连接的需求”——这种连接不仅是技术层面的,更是伦理层面的,直接挑战公众“技术无道德关联”的偏见。Barad的“纠缠”概念则揭示:人类与AI的边界并非固定,而是在数据交换、决策协同中持续流动(Puzio, 2025),这打破了科学家将人类视为“唯一道德主体”的学科定式。

这要求我们构建“关系中心伦理”(Relational-centered Ethics):在自动驾驶事故责任认定中,不应仅追问“AI是否犯错”(公众的简单归因偏见)或“人类是否失职”(科学家的单一责任认知),而需审视算法设计、人类操作、道路环境等要素的“共同责任”。承认AI的伦理地位,不是赋予其“人格”,而是承认技术已成为道德实践的参与者,这正是消解双重认知偏见的核心路径。

(3)承认AI能动性:破除“工具论”的认知偏见

新唯物主义彻底颠覆了公众与科学家普遍存在的“AI是被动工具”的认知偏见,赋予其“能动性”——这种能动性并非人类赋予的“意识”,而是在互动中生成的“行动能力”。Haraway将能动性拓展至非人类实体,指出AI通过数据处理、模式识别主动参与意义生产;Barad则强调:能动性是“内部作用”的实践结果,AI的决策偏好是与人类、数据、环境互动的产物(Puzio, 2025)。

例如,推荐算法通过用户点击数据“学习”偏好,进而主动塑造信息茧房——这种“主动响应”正是AI能动性的体现。这要求技术设计从“控制工具”(科学家的传统思维)转向“引导关系”:与其试图消除AI的能动性(公众的焦虑点),不如建立透明的互动规则,让AI的“行动”与人类价值对齐。

(4)身体多样性适配:消除AI设计中的“标准化身体”偏见

新唯物主义强调身体的“多元具身性(Plural Embodiment)”,拒绝标准化身体假设——这直指科学家在技术设计中易忽视的身体多样性偏见,以及公众对技术排斥性的担忧。Haraway的“技术生物权力(Techno-biopower)”概念揭示:AI系统中隐含对“正常身体”的预设——如语音识别对“重音”(accents)的歧视、VR设备对肢体障碍者的排斥,本质上是权力对身体的支配。Barad则指出:身体边界是动态建构的,AI假肢、脑机接口正在重新定义“身体”的范围(Puzio, 2025)。

这要求AI设计践行“身体多样性适配”:为视障者开发触觉反馈导航AI,为自闭症群体设计情绪识别辅助系统。技术不应强化“身体优劣”的偏见(公众的隐性担忧),而应成为拓展身体可能性的“共生伙伴”,纠正科学家的标准化设计思维。

(5)情境化知识反思:解构AI“客观中立”的认知偏见

Haraway的“情境化知识(Situated Knowledge)”概念批判了公众普遍认为AI“客观中立”的认知误区,以及科学家对技术中立性的过度信任——算法看似“中立”,实则嵌入训练数据中的权力关系。Barad的“伦理-本体-认识论(Ethico-onto-epistemology)”进一步指出:AI的“知识生产”始终与政治、经济权力纠缠,例如facial recognition(面部识别)系统对有色人种的误判,本质上是历史偏见的数据化(Barad, K., 2015, as cited in Puzio, 2025)。

因此,新唯物主义主张建立“批判性AI知识观”:在医疗AI诊断中,需审视训练数据是否覆盖不同种族、性别群体(纠正科学家的数据代表性偏见);在司法AI量刑中,需反思算法是否复制了历史量刑偏见(回应公众对“算法歧视”的焦虑)。承认知识的情境性,才能避免AI成为权力的“数字同谋”。

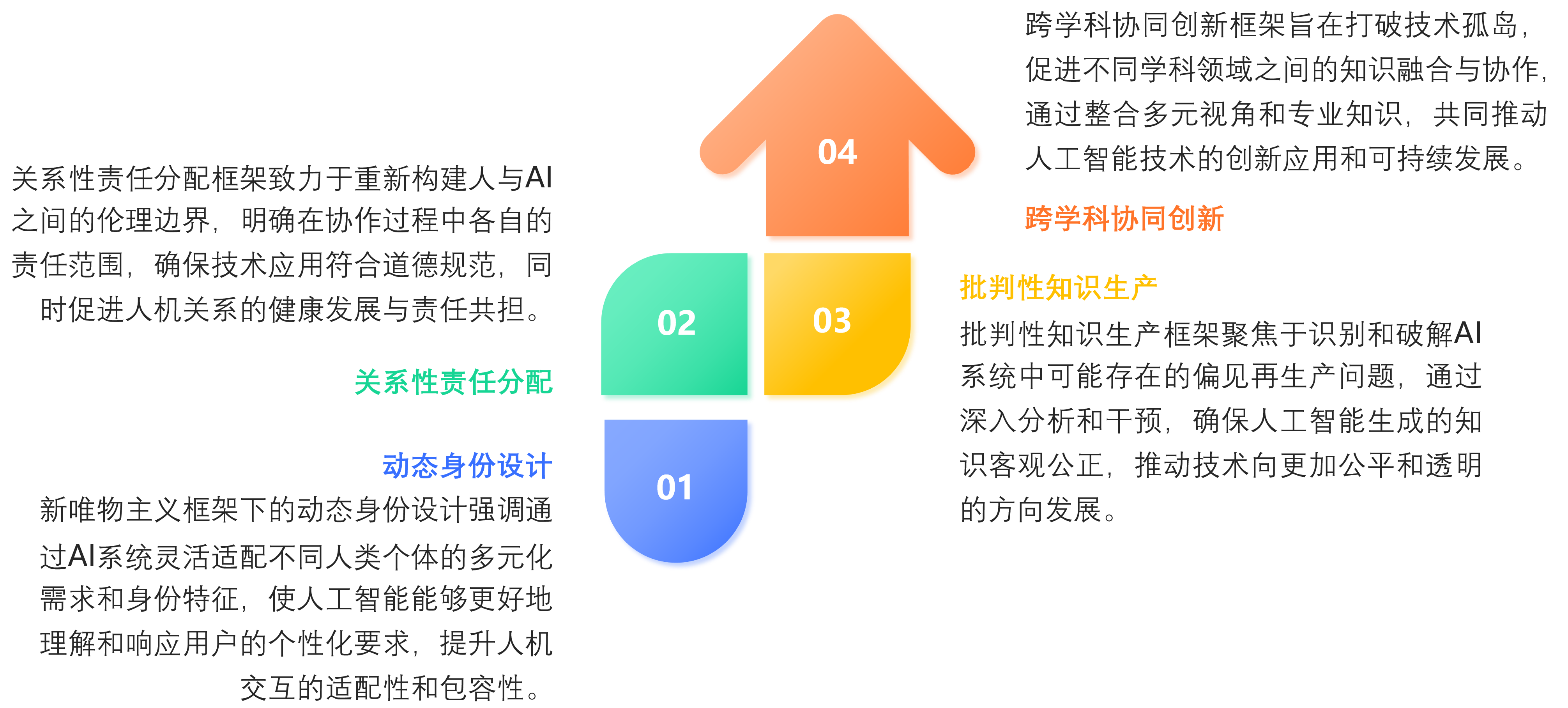

4 破解AI偏见的实践指南:新唯物主义四大行动框架

基于新唯物主义核心理论,Puzio构建了四大实践框架,为消解公众与科学家对AI的双重认知偏见提供系统性解决方案。每个框架均配备"行动指南针"——即一系列可操作的关键问题,帮助研究者与开发者将抽象理论转化为具体实践,有效破解"人类例外论"及相关偏见带来的认知困境。这些框架突破传统技术研究的线性思维,具有三大核心特征:(1)关系优先——以人-AI关系为分析核心,而非单一主体(破解“人类中心”偏见);(2)动态适配——承认技术与人类的协同演化,拒绝静态规则(打破公众“技术不变”的认知);(3)批判反思——审视技术设计中的权力结构与隐性偏见(如公众对AI的恐惧与科学家的技术乐观主义)。这三大特征共同构成了AI时代新唯物主义实践的基石,使每个行动框架既能聚焦AI时代的具体伦理与设计难题,又能通过配套可落地的反思问题形成完整闭环。

图3 AI时代新唯物主义四大实践框架(破解AI认知偏见路径)关系图

框架1:动态身份设计——破解“标准化人类”偏见,让AI适配多元人类

核心原则:拒绝将AI设计基于"标准化人类"假设(科学家易陷入的设计偏见),承认人类身份的多元性与流动性(回应公众对技术排斥性的担忧)。生成式AI常忽视身体差异(如语音助手对听障者的排斥),而新唯物主义主张:技术必须嵌入对"具身经验"的尊重——智能不仅是认知过程,更是身体与技术的互动实践(Puzio, 2025)。

实践指南针:(1)AI系统预设了哪些"理想用户"特征?是否隐含对认知方式、身体能力不同群体的排斥(如忽视视障者需求)?(2)如何设计动态调整机制,让AI适应不同用户的具身需求(如为运动障碍者开发眼动交互),以消解"技术适配单一身体"的偏见?(3)技术文档中是否明确记录了对多元身体经验的考量,避免科学家的"同质性设计"偏见?

框架2:关系性责任分配——破解责任归属偏见,重构人-AI伦理边界

核心原则:彻底超越"人类主责"(科学家的惯性认知)或"AI主责"(公众的简单归因偏见)的二元思维,建立"关系性责任"模型。脑机接口、自动驾驶等技术中,人类与AI的"混合行动"已无法拆分责任主体——正如假肢使用者将设备视为身体一部分,AI也成为人类决策的"共生伙伴"(Puzio, 2025)。

实践指南针:(1)AI系统的决策链中,人类与非人类要素(算法、数据、传感器)如何"纠缠"?是否存在将责任单一归因于人类或AI的偏见?(2)能否建立可视化的责任图谱,明确各要素的贡献与风险,消解公众"AI全责"或科学家"人类主责"的认知偏差?(3)当AI出错时,如何避免单一主体追责(公众与科学家的常见偏见),而是优化整个关系网络?

框架3:批判性知识生产——破解AI知识生产中的偏见再生产

核心原则:揭示AI知识生产中的权力结构,避免技术成为偏见的"数字放大器"(公众担忧的算法歧视,科学家易忽视的训练数据偏见)。新唯物主义指出,定义"智能""正常"的过程本质是权力实践——当AI用西方白人男性数据训练时,会隐性排斥其他群体(Puzio, 2025)。因此,需整合非西方本体论(如非洲Ubuntu(乌班图)的"关系性存在"思想),打破单一知识体系霸权,消解科学家的文化中心主义偏见。

实践指南针:(1)AI训练数据中隐含哪些历史偏见(如性别、种族)?如何量化评估偏见影响(回应公众对算法公平性的质疑)?(2)能否引入多元文化视角重构算法逻辑(如融入 Indigenous 知识体系),纠正科学家的单一文化视角偏见?(3)技术团队是否包含多元背景成员,以避免"同质性盲区"(科学家易忽视的群体偏见)?

框架4:跨学科协同创新——消解学科偏见,打破技术孤岛

核心原则:AI伦理问题无法单靠技术解决,需哲学、社会学、伦理学、计算机科学的"超学科协作(Transdisciplinary Collaboration)"——这有助于打破科学家的技术中心主义偏见与公众对技术的认知误区。例如,AI医疗诊断的伦理争议,需技术专家优化算法透明度,伦理学家构建关系性伦理框架,社会学家调研不同群体的接受度——这种协同才能实现技术的"包容性创新"(Puzio, 2025)。

实践指南针:(1)如何建立AI伦理的跨学科协作机制(如哲学家与算法工程师共同设计伦理框架),避免技术专家主导的单一叙事偏见?(2)AI技术叙事中是否隐含"人类例外论"(科学家的学科偏见)?如何构建"人机共生"的替代性叙事(消解公众的技术恐惧)?(3)能否通过用户访谈、民族志等方法,记录不同群体与AI的真实互动经验,纠正科学家的"实验室视角"偏见?(4)如何用混合研究方法(如算法审计+社会调查)分析AI的物质-话语实践,平衡技术逻辑与公众感知?

新唯物主义视角下AI偏见消解实践需遵循“问题诊断—边界重构—关系优化—权力纠偏—迭代反思”五大实施步骤:(1)问题诊断:识别AI系统中的排斥性问题(如算法偏见、数据代表性不足,回应公众与科学家的认知盲区);(2)边界重构:打破人类-AI的固定边界(如承认AI在决策过程中的实质性参与,破解“人类中心”偏见);(3)关系优化:设计透明的人-AI协作机制(如可解释的算法决策过程,消解公众“黑箱恐惧”与科学家“技术万能”偏见);(4)权力纠偏:通过多元数据采集与跨文化视角平衡知识生产中的权力结构(纠正科学家的文化偏见);(5)迭代反思:基于实践反馈持续优化技术设计,形成动态改进闭环(避免静态认知偏见)。

5 新唯物主义视角下的AI偏见消解实践场域

新唯物主义技术人类学并非抽象理论,而是可直接应用于AI实践的行动框架。它能有效破解AI设计中科学家的“标准化陷阱”、伦理评判的公众“人类中心困局”、健康技术的“单一认知偏差”,为智能时代消解AI偏见提供包容性发展路径:

图4 新唯物主义技术人类学实践场域(AI偏见消解)应用示意图

(1)AI设计:消解“标准化排斥”偏见,实现多元适配

典型案例:面部识别技术的种族偏见(公众关注的公平性问题)、智能穿戴设备对残障群体的排斥(科学家设计忽视)、生成式AI的性别化语言倾向(公众与科学家的隐性偏见)。

传统困境:AI设计默认“白人男性身体”“标准认知模式”(科学家的标准化设计偏见),导致跨性别者、黑人、肢体障碍者成为“技术边缘人”(公众感受到的技术排斥)。例如,某面部识别系统对深肤色人群的误识率是浅肤色人群的34.7倍(Puzio, 2025)。

新唯物主义方案: 建立“多元具身设计工坊”,邀请残障者、跨文化群体参与AI原型开发(纠正科学家的设计偏见); 推行“数据酷儿化(Queering Data)”,打破性别、种族的二进制分类,用动态标签替代固定身份数据(消解公众对身份分类的固化认知); 将AI视为“关系伙伴”,设计可协商的交互规则(如语音助手支持非标准口音的动态学习,回应公众的使用需求)。

(2)AI伦理:消解“人类主责/AI主责”二元偏见,构建关系共担机制

典型案例:自动驾驶事故责任认定(公众“AI全责”偏见 vs 科学家“人类主责”偏见)、AI医疗诊断失误追责(公众对技术可靠性的质疑)、算法推荐的信息茧房伦理(科学家对技术中立性的误判)。

传统困境:伦理评判陷入“人类控制”(科学家惯性认知)或“机器自主”(公众简单归因偏见)的二元对立,要么要求人类对AI行为负全责,要么主张赋予AI法律人格,均忽视人-AI的纠缠本质。

新唯物主义方案: 构建“关系责任图谱”(Relational Responsibility Mapping),明确人类(开发者/用户)、算法(决策逻辑)、数据(训练样本)在伦理事件中的贡献权重(平衡公众与科学家的责任认知); 将伦理嵌入AI开发全流程,在算法设计阶段预设“纠缠伦理模块”(如自动识别高风险决策场景并触发人类审核,消解公众“算法失控”恐惧); 建立“技术-社会”协同治理机制,让工程师、伦理学家、用户代表共同制定责任分配准则(打破科学家技术主导偏见)。

(3)AI健康:破解“量化至上”偏见,转向关系疗愈

典型案例:AI心理健康监测(忽视非量化体验的科学家偏见)、数字孪生手术规划(公众对技术替代医生的担忧)、远程医疗机器人交互(科学家对技术效率的过度关注)。

传统困境:AI健康技术将身体简化为数据指标(如步数、心率)(科学家的量化指标偏见),忽视患者的疼痛体验、心理状态等“非量化健康维度”(公众对人性化医疗的需求)。例如,某AI抑郁筛查系统仅依赖语言特征,遗漏了文化差异导致的表达差异(Puzio, 2025)。

新唯物主义方案: 开发“关系型健康AI”(Relational Health AI),将患者、家属、医护人员、环境数据纳入健康评估模型(整合多元视角,纠正科学家的单一数据依赖); 设计“具身交互界面”(Embodied Interaction Interface),通过触觉反馈、情感语音合成等技术还原非量化健康体验(回应公众对人性化医疗的需求); 建立“多元健康知识库”(Pluralistic Health Knowledge Base),整合西医、中医、原住民(Indigenous)传统医学对健康的不同认知(打破科学家的单一医学体系偏见)。

(4)脑机接口:消解“认知边界固化”偏见,重构人-AI的“认知共生”

典型案例:渐冻症患者的意念打字系统(公众对“机器取代人体功能”的恐惧偏见)、AI辅助记忆增强脑机接口(科学家对技术认知增强的乐观偏见)、沉浸式VR脑控交互(公众与科学家对认知边界的固化认知)。

传统困境:将脑机接口(Brain-Computer Interface, BCI)视为“人类控制技术”(科学家的“人类主导”偏见),忽视AI算法对神经信号的主动解读与重构(公众对“技术被动工具”的认知误区)。例如,某脑控假肢系统因算法“过度矫正”使用者意图,导致动作延迟——这正是忽视AI能动性的典型后果(Puzio, 2025)。

新唯物主义方案: 开发“双向学习脑机接口(Bidirectional Learning BCI)”,让AI与人类大脑形成“认知闭环”(如算法实时调整解读策略以适应神经信号变化,消解科学家的“控制欲”偏见); 建立“神经伦理委员会(Neuroethics Committee)”,评估脑机接口对自我认知的重构风险(回应公众对“自我认同危机”的担忧); 设计“可解释的神经反馈界面(Explainable Neural Feedback Interface)”,让使用者理解AI如何“解读”其意图(打破公众对“黑箱技术”的恐惧)。

(5)算法公平:消解“技术纠偏”的表面化偏见,转向关系重构

典型案例:招聘算法的性别歧视(公众关注的公平性问题)、贷款审批AI的种族偏见(科学家易忽视的历史数据偏见)、高校录取系统的阶层固化效应(公众与科学家对“ meritocracy”的认知偏差)。

传统困境:仅通过“算法优化”消除显性偏见(科学家的技术中心主义偏见),未触及深层的“人类例外论”预设——如将“高学历=高能力”的固化认知(公众与科学家的共同偏见)编码为算法规则。

新唯物主义方案: 建立“算法偏见溯源机制(Algorithmic Bias Tracing Mechanism)”,识别训练数据中隐含的权力关系(如历史薪资差距数据对性别偏见的强化,纠正科学家的数据中立假设); 推行“关系型算法审计(Relational Algorithmic Audit)”,评估算法对不同群体的差异化影响(回应公众对算法公平的诉求); 开发“多元价值嵌入工具(Pluralistic Value Embedding Tool)”,让AI在决策时权衡效率、公平、文化包容等多元目标(打破科学家的单一效率导向偏见)。

6 消解“人类例外论”偏见:AI时代的“人之本质”再思考

(1)新唯物主义的核心洞见:破解AI偏见的理论基石

面对AI对“人之本质”的挑战,新唯物主义技术人类学提供了三大颠覆性洞见:

动态身份观:人类不再是拥有固定本质的“例外存在”(公众的静态认知偏见),而是与AI持续纠缠的“关系性存在”(打破科学家的人类独特性假设)。生成式AI的协作写作、脑机接口的认知增强,正在重新定义“创造力”“智能”的边界——这种边界重构不是对人类价值的消解,而是对生命可能性的拓展。

关系伦理观:AI伦理的核心不是“人类如何控制技术”(公众的控制欲偏见),而是“如何构建健康的人-AI关系”(纠正科学家的技术中立论)。自动驾驶的“电车难题”不应纠结于“牺牲谁”,而应追问“如何设计体现多元价值的决策机制”——让技术成为放大人类共情能力的工具,而非冰冷的功利计算器。

实践导向观:新唯物主义不是抽象的哲学思辨,而是可操作的行动框架(回应公众“理论无用”的偏见)。从多元具身设计到关系责任图谱,这些工具帮助我们将“共生”理念转化为技术实践——例如,某AI医疗系统通过整合患者口述症状与生理数据,实现了对“非典型症状”的精准识别(Puzio, 2025),纠正了科学家“数据至上”的认知偏差。

批判性反思:承认技术的“双刃剑”效应——AI既可能强化偏见(如算法歧视),也能成为打破歧视的力量(如多元具身设计)。关键在于:我们是否有勇气解构“人类例外论”的傲慢(科学家的学科偏见),以谦卑的态度与技术共同演化?这或许是AI时代人类必须回答的存在论命题(引发公众与科学家的共同反思)。

(2)AI实践的现实挑战与突破路径:消解偏见的落地难题

将新唯物主义理念转化为AI实践并非易事,当前面临三大核心挑战(反映公众与科学家的认知差距),这些挑战也正是未来消解偏见的关键突破方向:

伦理落地难题:“纠缠”“能动性”等概念如何转化为可执行的AI伦理规范(公众对理论抽象性的质疑)?例如,自动驾驶的“关系责任”如何量化分配(科学家的技术落地困境)?这需要技术开发者、伦理学家、法律专家共同制定“伦理转化手册(Ethics Translation Manual)”,将抽象理论拆解为算法可识别的规则(弥合公众与科学家的认知鸿沟)(Puzio, 2025)。

关系边界模糊:承认AI能动性后,如何避免陷入“技术决定论”(公众对技术失控的恐惧偏见)?关键在于建立“动态边界协议(Dynamic Boundary Protocol)”——例如,医疗AI辅助诊断需明确“人类最终决策权”(平衡科学家对技术自主性的过度信任),同时赋予AI“异议权”(当算法识别异常数据时主动提示人类复核,消解公众“算法替代人类”的焦虑)。

多元数据缺失:现有AI训练数据多来自西方语境,缺乏非西方文化中的人技互动经验(科学家的西方中心主义数据偏见)。需开展“全球技术民族志(Global Technological Ethnography)”,采集不同文化背景下的AI使用案例(如非洲社区的移动支付AI、东南亚的农业预测AI),构建真正多元的训练数据集(纠正公众对技术普适性的认知误区)。

跨学科协作障碍:技术专家与人文学者的话语体系差异导致协作低效(科学家的技术本位偏见与公众对跨学科协作价值的低估)。建议建立“翻译者机制(Translator Mechanism)”——培养既懂算法又通哲学的跨学科人才,搭建技术与人文的沟通桥梁,避免新唯物主义沦为“学术空谈”(弥合公众与科学家的认知隔阂)。

延伸阅读

Barad, K. (2007). Meeting the universe halfway: Quantum physics and the entanglement of matter and meaning. Duke University Press.

Barad, K. (2015). Onto-epistemologies and ethics: The matter of practice. In D. Coole & S. Frost (Eds.), New materialisms: Ontology, agency, and politics (pp. 33-63). Duke University Press.

Haraway, D. (2004). The companion species manifesto: Dogs, people, and significant otherness. Prickly Paradigm Press.

Hoppe, T., & Lemke, T. (2021). Agency in the age of algorithms: A new materialist perspective. Theory, Culture & Society, 38(1), 5-26.

Puzio, A. (2025). Entangled humans: A new materialist approach to technological anthropology. Journal of Technological Anthropology, 12(3), 45-67.

转载本文请联系原作者获取授权,同时请注明本文来自廖景平科学网博客。

链接地址:https://wap.sciencenet.cn/blog-38998-1524692.html?mobile=1

收藏