博文

深度学习多隐层架构数理逻辑浅析(十八)(2)

|

18.2 特征属性的等价表示类

在深度学习语境中,“特征基”通常指的是由网络权重(特别是某一层的权重矩阵)所定义的过滤器或投影方向。每一层的权重矩阵的每一行(在CNN中是每个卷积核)都可以看作一个“基向量”,它们构成了每个层级的子特征空间参照系的基。深度学习神经网络中可训练和推理的学习参数(如卷积核权重、全连接层权重矩阵),是特征基的组成部分。

在深度学习口语中,“特征值”通常指输入数据在这个由权重定义的“特征基”上的投影经过非线性激活函数得到的具体数值。通过权重参数对输入数据进行变换后得到的中间表示,是特征基上的特征值的具体实现。更准确的说法是特征激活值或特征图。

一、隐层的非显性谱分析(特征值)日常我们谈及所谓的“创新”,主要就是指找到新的(或者性能更优的)特征基,然而找到新特征基何其之难啊?并且,构建合适参照系找到各层级完备特征基系,更加是难上加难。找特征基的过程,对于深度学习AI称为训练阶段。

不过,在完备参照系中精准度量识别标签对象,则相对容易得多。这只要把标签对象的特征属性在参照系特征基上进行投影,即可获得它的特征值参数。标签对象特征值投影过程,对于深度学习AI称为推理阶段。

训练的本质是构建参照系,参照系的基础是找到合适的特征基。推理的本质是测量对象在参照系(特征基系)上的投影值(特征值)。权重参数集是特征值集的“生成器”,特征值集并非固定不变,而是随输入数据的不同而变化,但其变化规律由权重参数集决定。例如,对于同一模型(权重参数集固定),输入不同的图像(如猫、狗),隐层的特征值集激活不同投影值: 当输入猫的图像时,隐层中负责“猫耳”“猫眼”的特征神经元会被激活(与猫相关特征投影值较大); 当输入狗的图像时,隐层中负责“狗嘴”“狗腿”的特征神经元会被激活(与狗相关特征投影值较大)。权重参数集会逐渐学习到最能描述数据特征的模式,从而使特征值集具有更强的判别力(如能更好地区分猫和狗)。

在训练过程中,模型会根据预测结果与真实标签之间的误差(损失函数),通过反向传播算法计算损失函数关于权重参数的梯度,然后使用优化算法(如随机梯度下降SGD、Adam等)来更新权重参数。而特征值在这个过程中起到了传递信息的作用,因为误差是基于特征值计算得到的预测结果来衡量的。也就是说,特征值的质量和分布会影响权重参数的更新方向和幅度,进而影响模型的学习效果。 特征值由权重参数计算得出,特征值的计算依赖于隐层的权重参数集。每个神经元将输入数据与对应的权重相乘并求和,再经过激活函数处理后得到输出特征值。可以说,权重参数决定了输入数据如何被组合和转换为特征值。例如在全连接层中,如果输入特征数为m,输出特征数为n,那么权重维度为 (n, m),通过矩阵乘法和加法运算得到输出特征值。在深度学习模型中,输入数据进入网络后,从输入层开始,依次经过各个隐藏层。每一层的神经元会对输入进行加权求和(权重即隐层权重参数集),再通过激活函数进行非线性变换,从而得到该层的输出,这个输出就是该层提取到的特征值。例如在图像识别的卷积神经网络中,输入图像经过卷积层的卷积核(权重)进行卷积操作后,再通过ReLU等激活函数,得到特征图,特征图上的每个元素就是特征值。深度学习模型通常具有多层结构,能够实现层次化的特征提取。底层的特征值往往较为简单和具体,随着网络层数的增加,特征基会逐渐变得更加抽象和高级。以图像识别为例,底层卷积层可能提取到边缘、纹理等特征,而高层卷积层则能提取到物体的部分或整体特征。深度学习中常说的“特征提取”是指权重对输入数据的语义特征映射(数据层面的特征),而线性代数的“特征值/特征基”是权重矩阵对角线元素的数学属性(算子层面的特征)。深度学习中并无显式“训练生成特征基再求特征值”的过程,特征值/奇异值集是对模型训练得到的权重矩阵/特征变换矩阵做后验线性代数分解的结果,是对已训练权重的数学分析产物。先训出权重→再对权重/相关矩阵做EVD/SVD→分解得到特征值/奇异值集+特征基/奇异基系。若分析的是方阵(如方阵权重W∈R^n× n、隐层激活前的协方差矩阵),直接做特征值分解(EVD):W=Qλ Q^-1,λ为对角矩阵,对角元就是特征值集λ_1,λ_2,...,λ_n,Q的列向量就是对应的特征基(特征基系)。 若分析的是长方形权重矩阵(深度学习中多数情况,如W∈R^m× n,m ≠ n),做奇异值分解(SVD):W=Uσ V^T,奇异值矩阵σ的对角元σ_1,σ_2,...,σ_k是核心——其平方对应W^TW(或WW^T)的特征值,U/V则为对应的左/右奇异基(可理解为长方形矩阵的“广义特征基”),是深度学习中实际最常用的“特征基+特征值(奇异值)”形式。

隐层权重参数集与正则化特征值(奇异值)的核心联系,二者是“数学属性表征”(量子态位置特征值x)与“参数实体”( 实体空间位置x )关系。隐层权重W的本质是对前层特征的线性变换算子,其特征值/奇异值集就是这个线性变换的“谱特征”:特征值的模|λ|(或奇异值σ)表示变换在对应特征基上的缩放强度,特征值的幅角(复特征值)表示旋转变换,特征基则是变换的“主轴方向”——权重矩阵的线性变换能力,完全由其特征值(奇异值)× 特征基(奇异基)刻画。模型训练的目标是优化权重参数集以拟合数据,而权重优化的过程,等价于间接调整其特征值(奇异值)集和特征基系,让权重的线性变换效果匹配数据的特征分布:比如数据中重要的特征维度,会对应权重矩阵中更大的特征值/奇异值(变换时被放大,更易被后续层捕捉),次要特征则对应更小的特征值(被压缩)。特征值/奇异值的统计属性是衡量模型性能的隐层权重好坏的核心指标,决定模型表现:◦ 谱半径(特征值模的最大值)/谱范数(最大奇异值):过大易导致梯度爆炸,过小易导致梯度消失,是深度网络训练的核心痛点;◦ 条件数(最大/最小奇异值之比):越大表示权重矩阵的特征值分布越分散,模型泛化能力越差、训练收敛越慢;◦ 特征值稀疏性:若大部分特征值趋近于0,说明权重矩阵的有效变换维度少,隐层特征提取能力弱。深度学习的特征值集是通过前向传播过程从输入数据中动态提取的,而特征基(即权重参数集)是通过反向传播不断优化的。特征基定义了特征提取的方式,特征值是特征基作用于输入数据后的具体结果。这种数据驱动的特征学习机制使深度学习能够自动发现数据中的重要模式,无需人工设计特征,是其在图像、语音、文本等领域取得成功的关键原因。

深度学习作为时变非线性系统,不存在对角矩阵那样的全局特征值的显式迹,但可通过各个隐层获得每个隐层局部的子层切空间谱特性。

1、 权重矩阵的谱分析(最浅层)对第l层权重矩阵 W_l 直接进行特征分解:W_l = Q_l λ_l Q_l^-1,获得的特征值 λ_l 反映, 决定信号放大/衰减强度(与梯度消失/爆炸直接相关)的 奇异值谱;矩阵可逆性条件,影响优化曲面曲率; 但局限性忽略了非线性激活函数 f(.)。

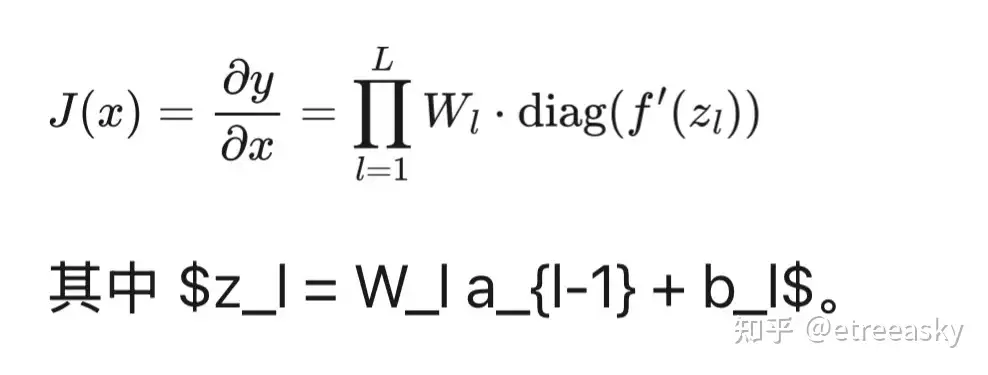

2. 雅可比矩阵的线性化(动态核心),在训练点 x 处,网络的前向映射局部线性化为:

这里的特征值获得方式, 谱半径 ρ(J) 决定不动点稳定性(连接螺旋吸引子理论), 训练动态中,J 的特征值轨迹在复平面上螺旋收敛到稳定区域。 权重-特征值对偶性,每个参数 W_ij 都是特征空间的塑造者,其微小变动通过谱敏感性影响全局动态。权重参数是谱生成器,特征值是动态指纹,二者通过雅可比链式法则和Hessian几何深度纠缠。与标准LTI不同,深度学习的谱特性是数据驱动演化的、时变非线性的,这使其具有自适应稳定性——螺旋结构不是预设,而是涌现的秩序。

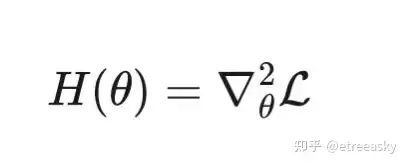

3. Hessian矩阵的二次型(优化层面),损失函数 L(θ) 对参数 θ 的二阶导数:

特征值正负决定鞍点/极小值(正定性), 特征值大小决定学习率适配、收敛速度,谱分布与批量大小、Sharpness-Aware M∈imization(SAM)相关。

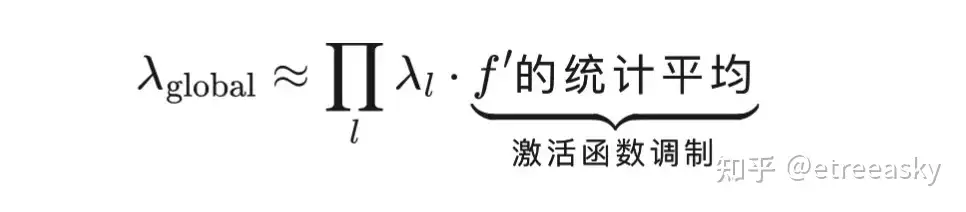

4. 层间特征值耦合:深层网络的特征值是各层谱的卷积,并不是简单相加:

5. 训练即谱演化,是反向传播本质上是特征值重分配过程。早期训练大特征值对应主模态(低频、通用特征),后期训练小特征值精细化(高频、细节拟合)。螺旋-稳定性联系显化,复平面特征值 λ = α + iβ 对应螺旋收敛/发散, 参数更新轨迹: θ_t+1 = θ_t - η ∇ L 在损失景观中形成梯度螺旋,层间信息传递特征值幅度衰减率 α 控制螺旋的紧致度,对应深度网络的抽象层级压缩。

二、等价表示类下面主要聊聊推理阶段,深度学习AI是如何在广义范围实现模式识别的?

深度学习模型的权重“函数”是特征基,“函数值”是特征值。 神经网络通过训练学习这个权重“函数”,使其能对任何输入计算出有用的“函数值”(特征值),最终用于分类、回归等任务。

我们知道,在向量空间投影特征值,形成对角矩阵,因为基向量是1×m的单列矩阵。但如果在高阶张量空间投影特征值,因为高阶张量基是n×m的高阶矩阵(甚至是n×m×…… l等等更高阶张量数据元形式),所以特征值矩阵在家高阶特征基下并不局限为对角矩阵。

经典物理实体空间的一个可观测物理量{x} 对应一个厄米算符。在其本征态下进行测量,结果确定性地得到相应的本征值(实数)。在该状态下,此算符的矩阵表示在其自身的本征基下是对角的,对角元就是本征值。本征值是算符固有的、实体出现的测量结果(实数)数值。

在量子力学中,一般的量子态(波函数)通常是多个本征态的叠加态。量子态的物理量算符特征值x的矩阵表示不一定是对角的,它是量子力学概率波期望值,即大量相同制备态下测量结果的平均值,它等于 <ψ|Â|ψ>,这可以看作是一个矩阵元(态矢量与算符作用后的内积),而不一定是对角元。

经典物理的 “实体特征值”,对应量子系统在经典极限下(ℏ→0)算符的对角化结果—— 此时不确定性ΔxΔp→0,量子行为退化为经典行为。

纠缠态在单个粒子算符的本征基下展开时,会出现非对角的交叉项。 这些交叉项正是量子纠缠的数学体现,也是经典物理无法描述的部分。

在非对角化情形中,相似矩阵、等价表示无疑具有“同一类”的特殊意义。

①某个对象b在某特征基系下的特征矩阵为B1,同一对象b的在另一组参照系特征基系下的特征矩阵为B2,则 B1,B2是同一线性变换在不同基下的矩阵,存在可逆矩阵 A 使:

B2=AB1A^−1

则B1,B2属于同一个相似类,该相似类是群GL(n)过共轭作用(A,B)↦ABA^−1下的轨道。这体现了同一线性变换在不同坐标系(基)下矩阵表示之间的等价关系。而 B1,B2 所在的相似类,就是共轭作用下的一条轨道—— 轨道的定义正是 “同一元素在群作用下的所有像的集合”,这个表述完美契合群作用的几何意义。相似类的不变量是分类的核心,轨道中的所有矩阵共享相同的相似不变量(迹、行列式、特征多项式、Jordan 标准型等),这也是判断两个矩阵是否属于同一相似类的充要条件 —— 本质是线性变换的固有属性不随基的选择而改变,矩阵只是线性变换的 “坐标表示”。

②从模层面更广义看,在表示论中若 V1和 V2 是同构的 kG-模(其中 k 是域,G是群),则存在模同构 A:V1→V2,固定 V1 和 V2 的基后,G 的作用可用矩阵表示:设 ρ1(g)和 ρ2(g)分别表示 g∈G在 V1 和 V2上的矩阵,则同构 A对应一个可逆矩阵,满足对任意 g∈G:

ρ2(g)= A(ρ1(g))A^−1

则有:ρ1和ρ12是等价表示,它们属于同一个等价表示类;这个等价类的构造依赖于模同构 A(或其矩阵形式)的共轭作用,而模自同构群是该作用在“同一模”情形下的群结构。上述等式是表示等价的核心条件—— 满足该式的两个表示 ρ1,ρ2 被称为等价表示,等价的表示在本质上描述的是同一个群作用规律,只是载体空间(模)的 “基” 不同,类似于矩阵的相似变换,这里是对所有群元素一致成立,所有模自同构构成群。

给定一个 kG-模 V,其所有模自同构(即与 G-作用交换的可逆线性映射)构成一个群,记为 AutkG(V),它是 GL(V)的子群。

深度学习中的"非显性子特征"参数集与矩阵相似类有深刻联系。隐特征的本质在于,深度网络中的隐层特征不是直接可见的原始特征,而是通过非线性变换得到的潜在特征,这与矩阵相似类中特征值是矩阵的本质属性、不随基变换而改变的性质一致。 多隐层特征参数集的模式识别(如分类、聚类),本质是通过基变换(如权重矩阵的乘法)将原始数据映射到一个更易分离的特征空间,而矩阵相似类则是这一过程的线性代数基础。深度学习中的特征解耦(如IP-IRM算法)目标是将不同语义特征分离到不同的特征维度上,这与矩阵对角化过程(将矩阵相似变换为对角矩阵)高度相似。 相似类与特征表示,深度网络学习到的特征表示可以看作是在某个相似类中的特定表示,而网络的训练过程则是寻找最优的相似变换,使得特征表示对分类任务最有利。深度神经网络的每一层可视为对输入数据的非线性变换。隐层特征参数集(如权重矩阵)通过逐层抽象,将原始数据映射到更高阶的特征空间。尽管每一层的参数形式不同(如卷积核、全连接权重),但它们共同构成了一个特征提取流水线,最终输出对任务(如分类、回归)最有效的表示。这种逐层变换与基变换类似,均通过改变特征表示形式来揭示数据内在结构。参数优化的共性是迭代逼近与群作用,相似矩阵类是GL(n) 共轭作用下的轨道,即通过可逆矩阵A的连续作用生成。这种群作用体现了参数空间的对称性——不同基下的矩阵表示可通过群元素相互转换。深度学习多隐层特征参数集与矩阵相似类(或模自同构群)的内在联系,深度学习并非完全脱离传统数学框架,而是通过非线性变换和多层抽象,将线性代数的核心思想(如基变换、群作用)推广到更复杂的数据表示中。

相似变换本质,当网络学习到稳定的特征表示时,不同样本在特征空间中的相对关系应保持不变。这与矩阵相似变换 B = P^-1AP 的核心思想一致——保持特征值(本质特征)不变,仅改变表示基。 不变性原理,深度学习的聚类目标是学习变换不变性(如平移、旋转、尺度不变性),这与矩阵相似类中特征值在基变换下保持不变的性质高度对应。例如,CNN中的池化层设计正是为了实现这种不变性。 多隐层特征的"轨道"结构,深度学习中的多隐层特征提取过程形成了一个特征轨道,这与群论中的轨道概念高度相似,特征轨道形成随着数据通过网络层层传递,特征表示逐渐从低层的原始特征(如边缘、纹理)向高层的语义特征(如物体部件、整体结构)演变。这一过程形成了一个特征表示的轨道,类似于群作用下形成的轨道; 轨道不变性,在特征轨道上,同一类别的不同样本应保持相似的特征表示,即使它们经历了不同的变换(如不同角度、光照条件)。这与矩阵相似类中不同基下表示的等价性一致; 轨道分离性,不同类别的样本在特征轨道上应保持足够的距离,这与分类任务中要求不同类别的特征表示具有可分性一致。 模同构与特征对齐,从模理论角度看深度学习中的特征提取可以视为特征空间的同构映射。特征空间同构,深度网络通过学习将输入空间映射到特征空间,这一过程类似于模同构 A: V_1 to V_2,其中 V_1 是输入空间,V_2 是特征空间。 表示矩阵关系,在特征空间中,不同样本的特征表示应满足 rho_2(g) = A {rho_1(g) }A^-1,这与深度学习中要求特征表示对变换具有不变性一致。 特征对齐,深度学习中的特征对齐技术(如MMD、CORAL)本质上是在寻找一个变换矩阵 A,使得源域和目标域的特征分布相似,这与矩阵相似变换的目标完全一致。

深度学习的多隐层特征参数集与矩阵相似类(或模自同构群)之间存在深刻的对偶关系:①参数空间的相似类 对应 功能等价性,②特征空间的模结构 对应 语义层次性,③自同构群的对称性 对应 实现的冗余性。深度学习本质上是学习表示等价类,网络不是学习具体的权重数值,而是学习权重的相似类——那些能产生相同语义表示的功能等价参数集。深度学习真正的力量在于其非对角特征关联,其"非显性子特征"类似于张量积空间中的高阶关联多个神经元的联合激活模式,对特定变换(如平移、旋转)保持不变的激活模式的群作用下的不变特征,网络学习到的基元特征组合相当于表示论中的不可约子模。非显性特征对应于模的不可约分解,网络学习将输入数据分解为多个"特征子模"的直和,每个子模对应一种语义概念。将深度网络视为一个分层模系统,每层是一个k[G]-模(其中G是输入变换群),层间变换是模同态,整个网络是模的塔式结构。隐层特征形成分层模结构,每层是前一层的商模,提取更高阶的抽象特征。深度学习多隐层特征的本质是非线性特征空间的非显性结构,深度学习多隐层特征参数集的模式识别与矩阵相似类/模自同构群的联系,本质是“结构保持”与“基变换”的统一。深度学习可以被重新理解为,在庞大的参数相似类空间中,寻找能生成最优特征模结构的代表元的过程。深度学习多隐层特征提取与矩阵相似类/模自同构群之间的联系,揭示了特征表示的数学本质,特征提取过程本质上是在寻找数据分布的内在对称性,通过相似变换构建特征轨道,使同类样本在特征空间中保持相似,异类样本保持差异。深度学习中的特征空间可视为模(如多维向量空间或高阶张量空间),而不同模型学习到的特征空间则是同构的模。 特征空间的相似性度量(如CKA、HSIC)可视为模同构的判据,即若两个特征空间的相似性矩阵(如内积矩阵)一致,则它们同构。多隐层特征参数集的跨模型迁移(如预训练模型微调),本质是通过模同构映射(如线性投影)将一个模型的特征空间映射到另一个模型的特征空间,而模自同构群则是这一过程的代数结构基础。非线性特征的“结构保持”是超越线性的扩展,多隐层特征的非线性模式识别,本质是线性变换(权重矩阵)与非线性激活的结合,而矩阵相似类/模自同构群的“结构保持”思想,是其理论内核。深度学习多隐层特征参数集的模式识别与矩阵相似类/模自同构群的联系,本质是“结构保持”统一。深度学习隐层的 “非显性特征”,是数据的 “相似类不变量”,是“非显性特征不是矩阵对角线上的显性特征元”,这精准点出了核心 ——显性特征是 “对角矩阵对角元素对应的基下的坐标”,非显性特征是 “含纠缠复合因子的相似类不变量”。深度学习的层变换矩阵(卷积核、全连接权重)变换矩阵实现 “表象→表象” 的映射,且是可逆的;相似类的不变量(迹、特征多项式) 隐层的非显性子特征(如卷积层的边缘特征、Transformer 的注意力特征) 不变量 / 非显性特征是 “本质属性”,不随参照系 / 显性特征的变化而变化;GL(n) 共轭作用轨道数据的模式等价类(如 “猫” 类、“狗” 类) 轨道 / 模式类是 “同一本质的所有表象集合”。深度学习多隐层特征参数集与矩阵相似类(或模自同构群)的深刻内在联系,体现在二者均通过基变换或同构映射揭示数据本质结构,且在特征表示、参数优化与泛化能力层面具有共通性。代数结构与深度学习特征表征的底层关联核心逻辑是,深度学习隐层的非显性特征,本质是通过 “等价变换下的不变量提取”,实现对数据对象的 “相似类 / 模同构类” 刻画—— 这和线性变换的相似类、kG- 模的同构类,共享 “变换不变性” 核心思想。所有模式识别的本质是 “识别等价类”,而非 “识别单个特征”,无论是线性变换的矩阵表示、kG- 模的群表示,还是深度学习的特征提取,其底层目标都是忽略 “表象差异”,抓住 “本质等价性”线性变换的相似类,同一线性变换在不同基下的矩阵 ,这个类的核心是线性变换本身的固有属性(迹、行列式、Jordan 标准型)—— 基的选择是 “表象”,线性变换的不变量是 “本质”。GL(n) 共轭作用的轨道,就是 “同一本质、不同表象” 的集合。kG- 模的同构类同构的 V 1 ,V 2 属于同一个模同构类,核心是群作用在模上的固有规律—— 模的载体空间是 “表象”,群表示的等价性(ρ2 (g)=Aρ1 (g)A ^−1)是 “本质”。模自同构群描述的是模自身的对称变换,这些变换不改变群作用的本质。数据对象的 “显性特征”(如图像的像素、文本的词向量)是 “表象”,隐层的 “非显性子特征” 是对数据本质模式的刻画—— 不同的显性特征可能对应同一个本质模式(比如不同角度的猫脸,像素不同但本质是 “猫”),深度学习的目标就是提取这种 “模式等价类”。kG- 模的同构类从数学上严格定义了 “等价性” 与 “不变性”;而深度学习的多隐层特征提取,是从工程上近似实现了 “识别等价类” 的目标—— 隐层的非显性子特征,就是数据对象在 “特征变换群” 下的近似不变量,这些特征构成的空间,就是数据模式的 “相似类轨道”。kG- 模的自同构群描述了模的 “对称变换”—— 这些变换不改变群作用的本质,对应深度学习中特征的对称不变性。模自同构的核心是保结构变换:ϕ:V→V 满足 ϕ(g⋅v)=g⋅ϕ(v),即变换后群作用的规律不变。这对应深度学习中的数据增强操作:比如对图像进行平移、旋转、翻转,这些操作相当于 “特征空间的自同构变换”—— 变换后的图像特征,仍然属于同一个模式等价类(比如旋转后的猫还是猫)。深度学习对模自同构群的 “隐式学习”深度学习的模型训练过程,本质是学习模自同构群下的不变特征,数据增强相当于给模型输入 “模自同构变换后的样本”,迫使模型忽略变换带来的表象差异;卷积层的平移不变性,就是对 “平移变换群” 的自同构不变性的直接体现 —— 无论目标在图像的哪个位置,卷积层都能提取到相同的特征。群表示与深度学习的 “特征融合”kG- 模的表示矩阵满足 ρ2 (g)=Aρ1 (g)A^ −1,对应深度学习中的注意力机制:注意力权重矩阵相当于 “模同构矩阵 A”,通过对不同隐层特征的加权融合,实现 “在新的特征基下,保留模式的本质属性”的变换A,这是 注意力机制的本质,就是自适应地选择最优的 “特征基”,以提取最具区分性的不变量。

模自同构群的"神经网络版本"深刻性,构成无限维李群,其轨道正是损失景观的平坦方向(null space)——解释了过参数化的优化优势。特征参数集的"隐式谱",虽无对角特征值,但存在广义谱,不同初始化若收敛到相同谱分布,则属于泛函相似类。相似类的代数轨道坍塌为泛函空间的连续流形。从相似类到"伪共轭群胚",相似类的不变量是代数多项式,深度学习的不变量是拓扑几何,决策边界的同胚类,数据流形的拉回(pullback) 结构, 特征图的同调群激活空间。模式识别与相似类的"拓扑-几何"对偶。不同权重配置若产生同胚的决策边界,属于功能相似类——这超越了矩阵相似。 模层面的广群(Groupoid)结构,深度学习不同层深、架构的网络存在部分同构,形成广群——可逆但仅对部分对象定义复合(实例:知识蒸馏、迁移学习正是这种跨架构的模同态)。从代数到几何-统计的范式迁移终极洞察,相似类是点的等价(矩阵作为静态对象),深度学习是函数的等价(权重作为泛函参数)——前者在代数闭包中分类,后者在泛函空间中分类。深刻联系在于深度学习的特征参数集不是相似类的直接实现,而是其非线性幽灵, 全局被非线性摧毁, 局部在不动点处重生(雅可比相似), 统计在分布层面再现(谱密度), 对称在规范群层面扩展(重参数化不变性)。深度学习智能本质,放弃严格的代数不变性,换取灵活的拓扑鲁棒性。相似类是"死的"分类,深度学习是"活的"连续变形——函子的自然变换而非群元素的共轭。这是从静态结构工程到动态系统科学的范式跃迁。深度学习多隐层特征参数集模式识别与矩阵相似类(或模自同构群)的核心联系在于,深度神经网络通过多层非线性变换(非线性函数多层复合)构建的特征空间,本质上是在学习数据分布的内在对称性与不变性,这与矩阵相似变换保持特征值不变、模同构保持代数结构不变的数学原理高度一致。在深度学习中,每一层隐层都可以视为对输入数据进行特征基变换的过程: 线性变换视角,隐层的计算本质上是 h = sigma(Wx + b),其中 W 是权重矩阵,b 是偏置向量,sigma 是非线性激活函数。这可以看作是在特征空间中进行的仿射变换。

训练过程是寻找最优表示类的过程,梯度下降在参数空间中探索,最终收敛到某个相似类的代表元。泛化能力源于相似类的稳定性,好的相似类对数据分布的小扰动保持稳定。深度学习的多隐层通过非线性变换 + 特征组合,实现了 “从显性特征的坐标表示,到非显性特征的不变量表示” 的跃迁:①第一层(显性→浅层非显性):比如卷积层对图像像素的卷积,本质是在不同 “局部基” 下提取特征—— 卷积核相当于 “基变换矩阵”,输出的特征图是像素在新基下的表示,此时特征已经脱离了原始像素的 “显性属性”。②深层(浅层→深层非显性):通过池化、非线性激活函数(ReLU、Sigmoid)、残差连接等操作,过滤掉 “表象噪声”,保留 “本质不变量”—— 比如不管猫脸的角度、光照如何变化,深层隐层都会提取出 “耳朵形状”“眼睛分布” 等核心特征,这些特征就是 “猫” 这个模式等价类的不变量。③相似类的 Jordan 标准型:Jordan 标准型是相似类中最简洁的表示(“本质表示”),对应深度学习的瓶颈层特征—— 瓶颈层通过降维,将复杂的隐层特征压缩为最核心的不变量,相当于 “特征的 Jordan 标准型”。

将代数、几何中的群、模、流形等结构,引入深度学习,让模型更系统地学习变换不变性,形成“等价表示类”,从而提升泛化能力。深度学习模型与数学结构的深刻联系,不仅提供了理解深度学习的理论视角,也为构建更强大、可解释、稳健的AI系统提供了数学框架,为设计更有效的网络结构和训练方法提供了理论指导,为跨模型迁移、特征融合、可解释性等应用提供了代数结构的坚实基础。

【举例】

同一图形的特征属性是不变的,无论它以什么特征基来表达。同样图形的在不同特征基系下的不同参数集合,在线性空间中自对应不同矩阵,这些矩阵具有相似关系:A~B

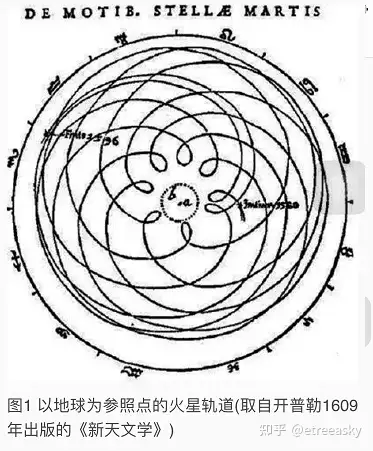

①等价类对于“子特征结构”等价类,一个形象例子是关于“火星轨道”图。

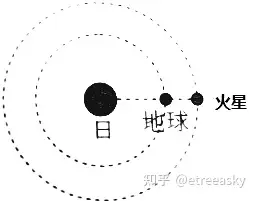

如果我们以地球为中心观测火星轨道,日积月累记录火星运行轨迹,会得到下面这张轨迹图:

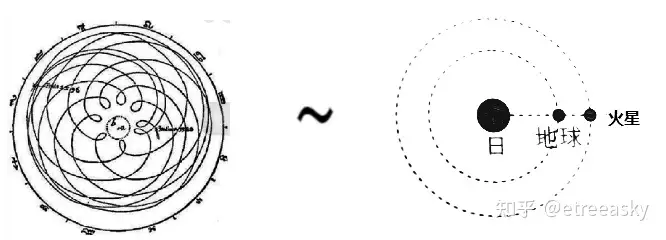

如今的我们知道,开普勒1609年绘制的这张火星轨道图过于繁杂了。因为当我们以太阳为中心审视火星轨道,其围绕太阳转圈的轨道图简单清晰,一目了然:

在地心学说时代开普勒以地球为原点得到的火星行驶轨迹图,与今天我们以太阳为中心得到的火星行驶轨迹图,是同一对象‘火星轨道’在地心和日心等不同参照系下的两种表象,它们彼此互为等价类:

虽然,如果选择参照系合适可能使问题描述变得清晰简单,反之参照系不合适会使问题描述变得纷繁复杂。但是,它们都能够准确推演火星的轨道位置。

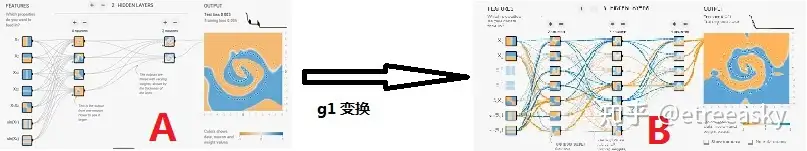

②变换群因为相似变换不改变特征属性, 同样的,深度学习架构的多隐层(多层线性空间)中,同一对象的不同特征基的不同参数集是等价类。如果我们把张量看作是广义矩阵,等价类也存在类似于相似矩阵的表达式。 如果我们把P看作A到B的变换,则所有这样的模P构成的集合,是一个群。比如,螺旋图形参数集A经过g1变换到螺旋图形参数集B ,如下图:

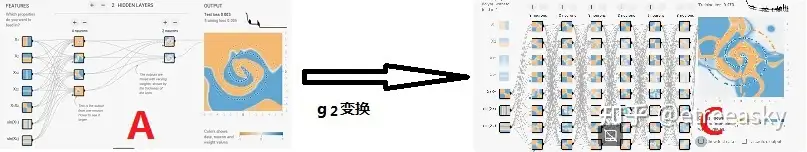

另外,螺旋图形参数集A经过g2变换到螺旋图形参数集C ,如下图:

类似的,同一对象的不同特征基的不同参数集之间的变换还有g3、g4、g5、g6......gn,则以变换g1、g2、g3、g4、g5、g6......gn为元素,组成集合G。注意这个G不仅仅是集合,还是一个群。因为相似变换不改变特征属性。

同一螺旋图形有着不同的等价类表示的参数集A、B、C......, 尽管这些等价类之间经过不同的相似变换g1、g2、g3...... 得到,但是所有这些变换元g1、g2、g3...... 属于同一个群G:

https://wap.sciencenet.cn/blog-1666470-1523724.html

上一篇:深度学习多隐层架构数理逻辑浅析(十八)(1)