博文

Logistic Regression(逻辑斯蒂回归)(续)

||

如何求解和优化(优化方法)--使经验误差最小的值?

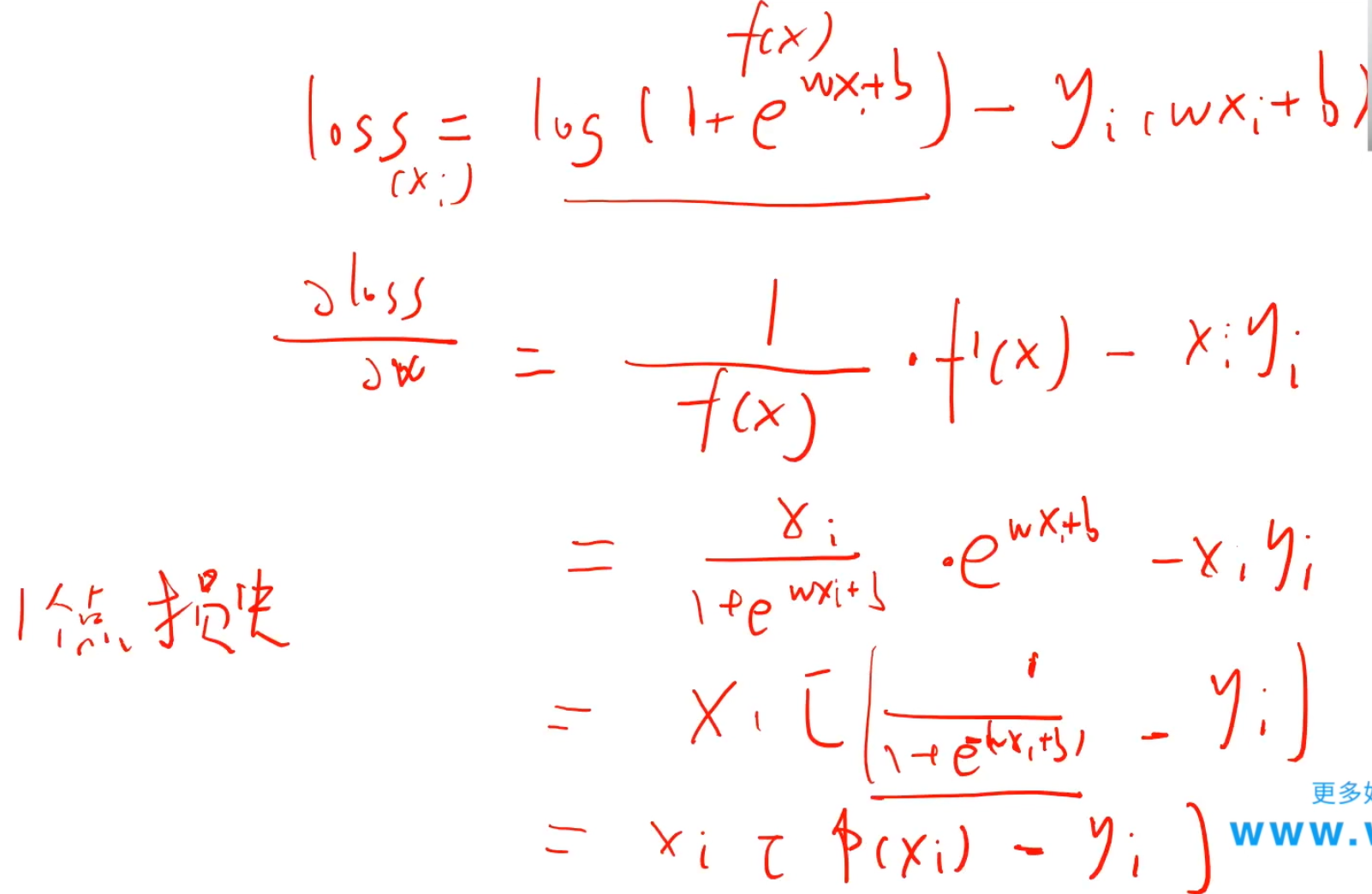

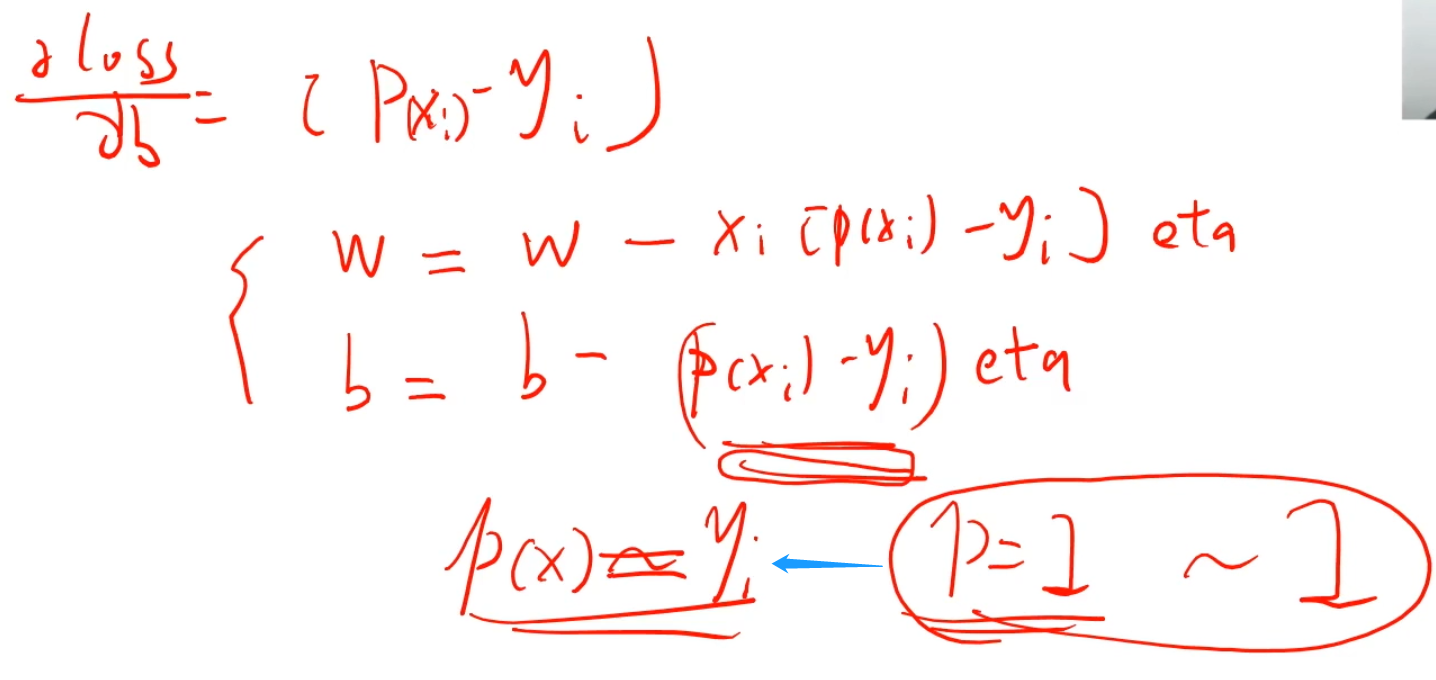

方法一:随机梯度下降法

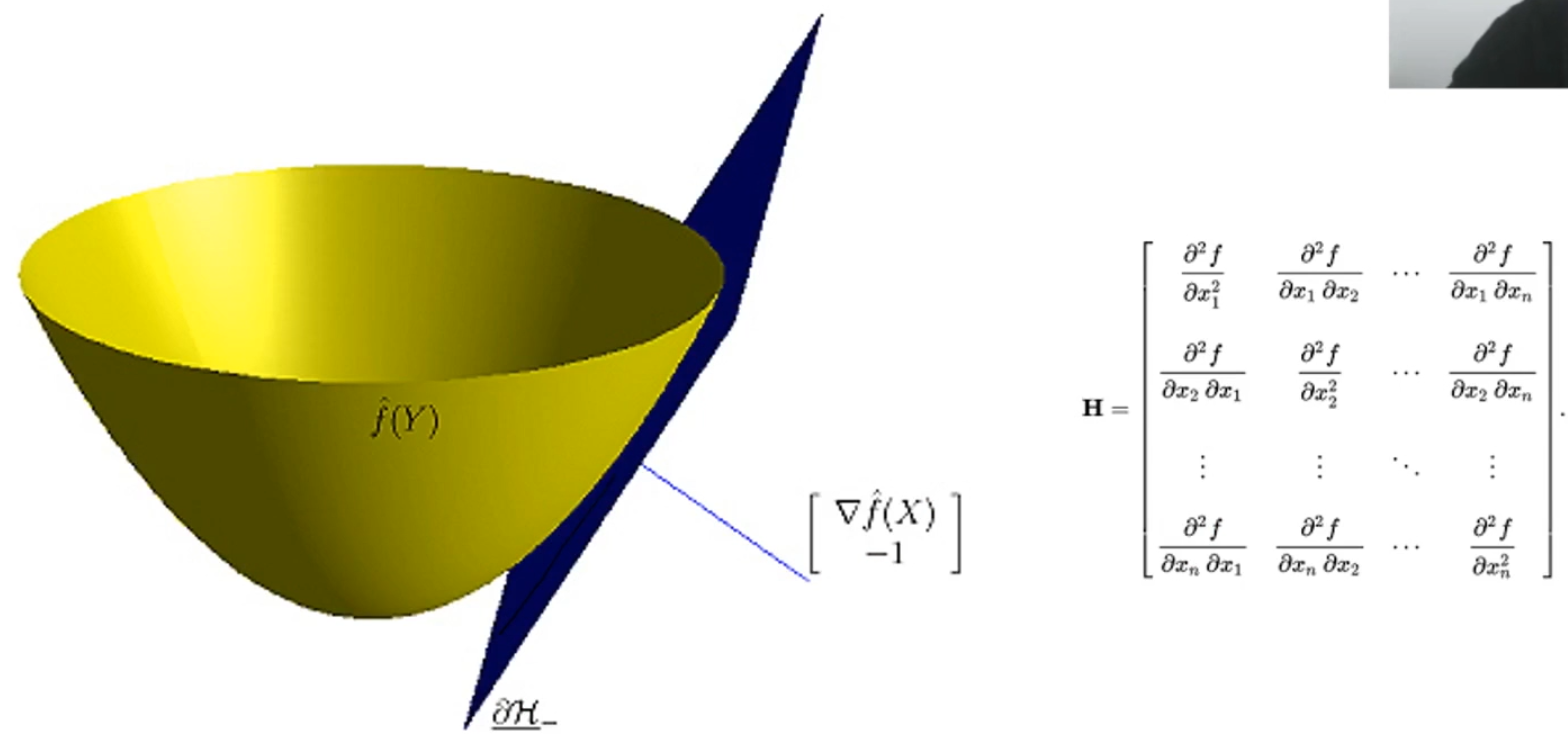

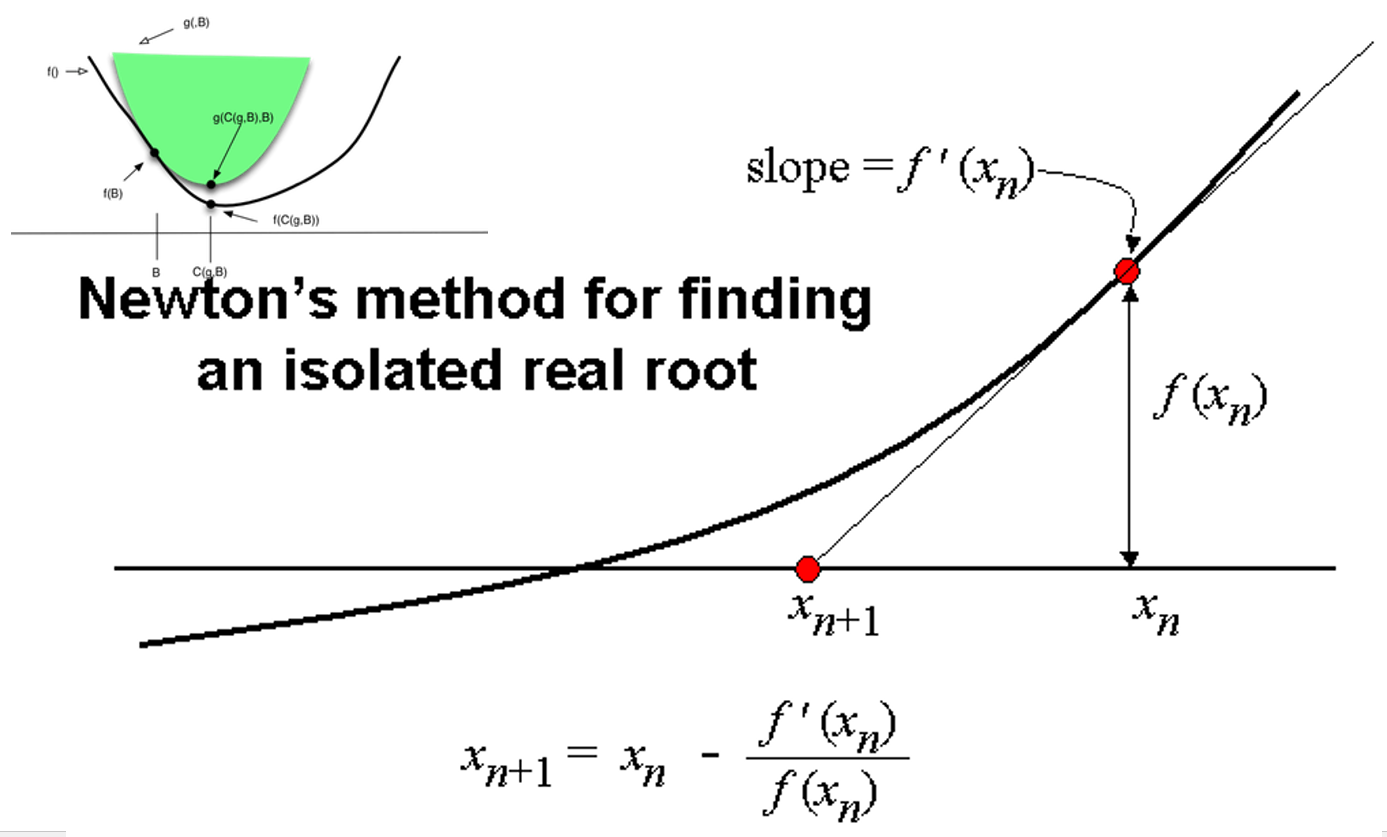

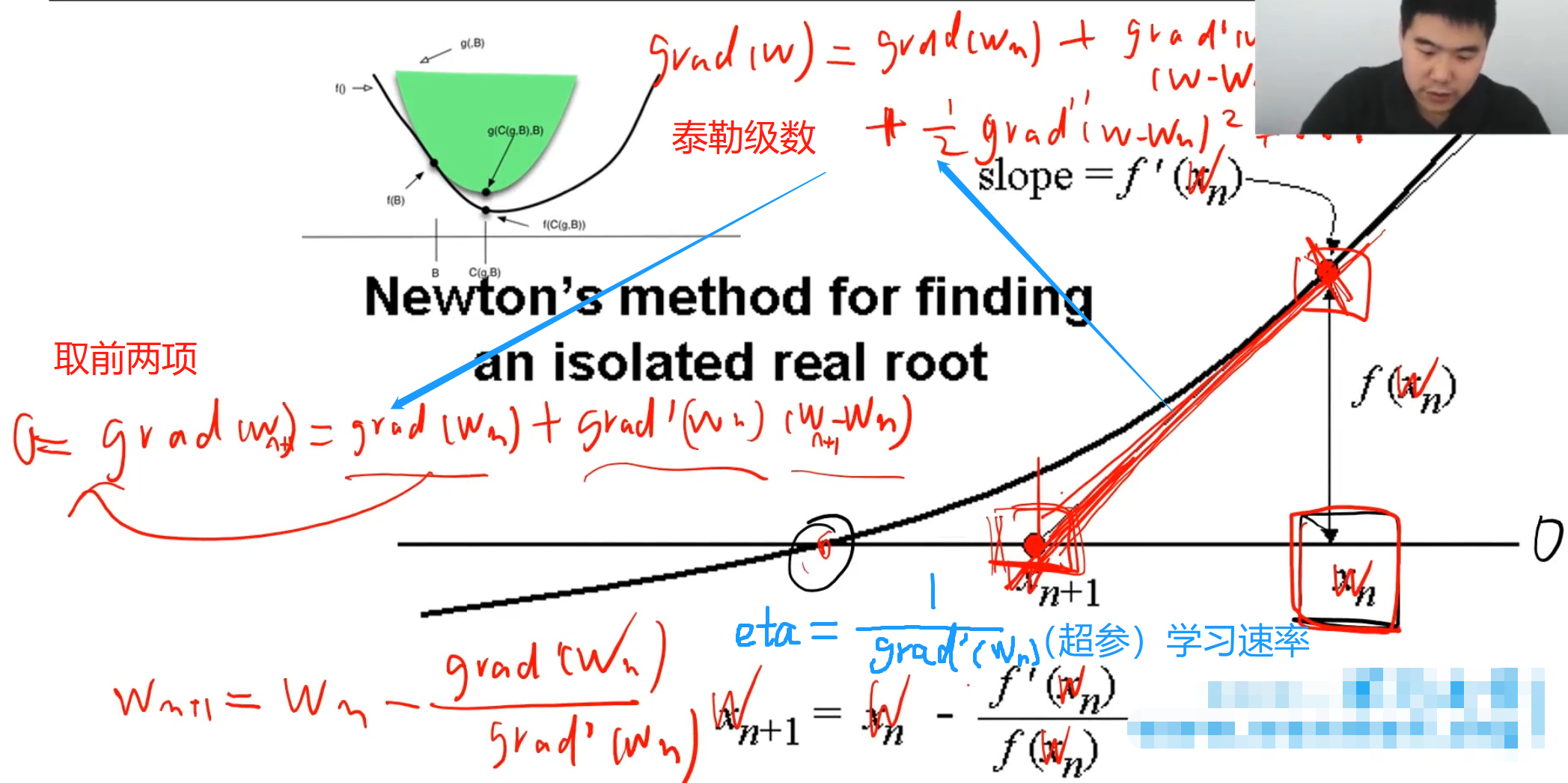

方法二:牛顿法(二阶优化方法)

凸优化问题:刚开始步子迈大一点,后来小一点,自适应去调整,比随机梯度速度更快。

eta的本质:移动步长

缺点:收敛性不好保证,可学习其思维。

方法延伸:加入正则项

点滴分享,福泽你我!Add oil!

https://wap.sciencenet.cn/blog-3428464-1231597.html

上一篇:概率论和统计学的区别

下一篇:决策树

扫一扫,分享此博文

全部作者的其他最新博文

- • [转载]太阳同步轨道

- • 膳食指南